Neues KI-Tool deckt raffinierte Deepfakes auf

Werkzeug der University of California Riverside überwindet den bisherigen Fokus auf Gesichter

|

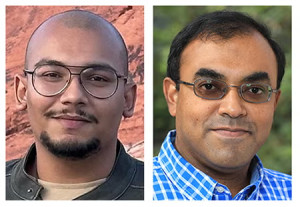

Rohit Kundu (links) und Amit Roy-Chowdhury entlarven Deepfakes (Fotos: ucr.edu) |

Riverside/Mountain View (pte001/29.07.2025/06:00)

Forscher der University of California Riverside haben ein leistungsstarkes Werkzeug zum Finden von Deep Fakes entwickelt. Amit Roy-Chowdhury und sein Doktorand Rohit Kundu sind gemeinsam mit Wissenschaftlern von Google einer Künstlichen Intelligenz auf der Spur, die Manipulationen an Videos erkennt, selbst wenn diese weit über Gesichtsaustausch und Sprachverfälschung hinausgehen.

Video kommt auf den Prüfstand

Das System namens "Universal Network for Identifying Tampered and synthEtic videos" (UNITE) erkennt Fälschungen, indem es nicht nur Gesichter, sondern ganze Videobilder einschließlich Hintergründen und Bewegungsmustern untersucht. "Deepfakes haben sich weiterentwickelt. Es geht nicht mehr nur um den Austausch von Gesichtern. Mit leistungsstarken generativen Modellen erstellen Menschen mittlerweile komplett gefälschte Videos, von Gesichtern bis hin zu Hintergründen. Unser System ist darauf ausgelegt, all das zu erkennen", so Kundu.

Frühere Deepfake-Detektoren seien fast ausschließlich auf Gesichtsmerkmale fokussiert gewesen. "Wenn kein Gesicht im Bild zu sehen ist, funktionieren viele Detektoren einfach nicht. Aber Desinformation kann viele Formen haben. Bereits das Verändern des Hintergrunds einer Szene kann die Wahrheit verzerren", unterstreicht der Wissenschaftler.

Recht auf Wahrheit als Richtschnur

UNITE verwendet ein Deep-Learning-Modell zur Analyse von Videoclips. Es erkennt subtile räumliche und zeitliche Unstimmigkeiten - Hinweise, die frühere Systeme oft übersehen haben. Das Modell stützt sich auf das KI-Modell "SigLIP", das Merkmale extrahiert, die nicht an eine bestimmte Person oder ein bestimmtes Objekt gebunden sind. Eine neuartige Trainingsmethode, die als "Attention-Diversity-Loss" bezeichnet wird, veranlasst das System, mehrere visuelle Bereiche in jedem Bild zu überwachen, sodass es sich nicht ausschließlich auf Gesichter konzentriert.

Die Zusammenarbeit mit Google, wo Kundu ein Praktikum absolvierte, verschaffte ihm den Zugang zu umfangreichen Datensätzen und Rechenressourcen, die für das Training des Modells mit einer Vielzahl synthetischer Inhalte erforderlich waren. "Die Menschen haben ein Recht darauf zu wissen, ob das, was sie sehen, echt ist. Und da KI immer besser darin wird, die Realität zu verfälschen, müssen wir besser darin werden, die Wahrheit aufzudecken", resümiert Kundu.

(Ende)| Aussender: | pressetext.redaktion |

| Ansprechpartner: | Wolfgang Kempkens |

| Tel.: | +43-1-81140-300 |

| E-Mail: | kempkens@pressetext.com |

| Website: | www.pressetext.com |